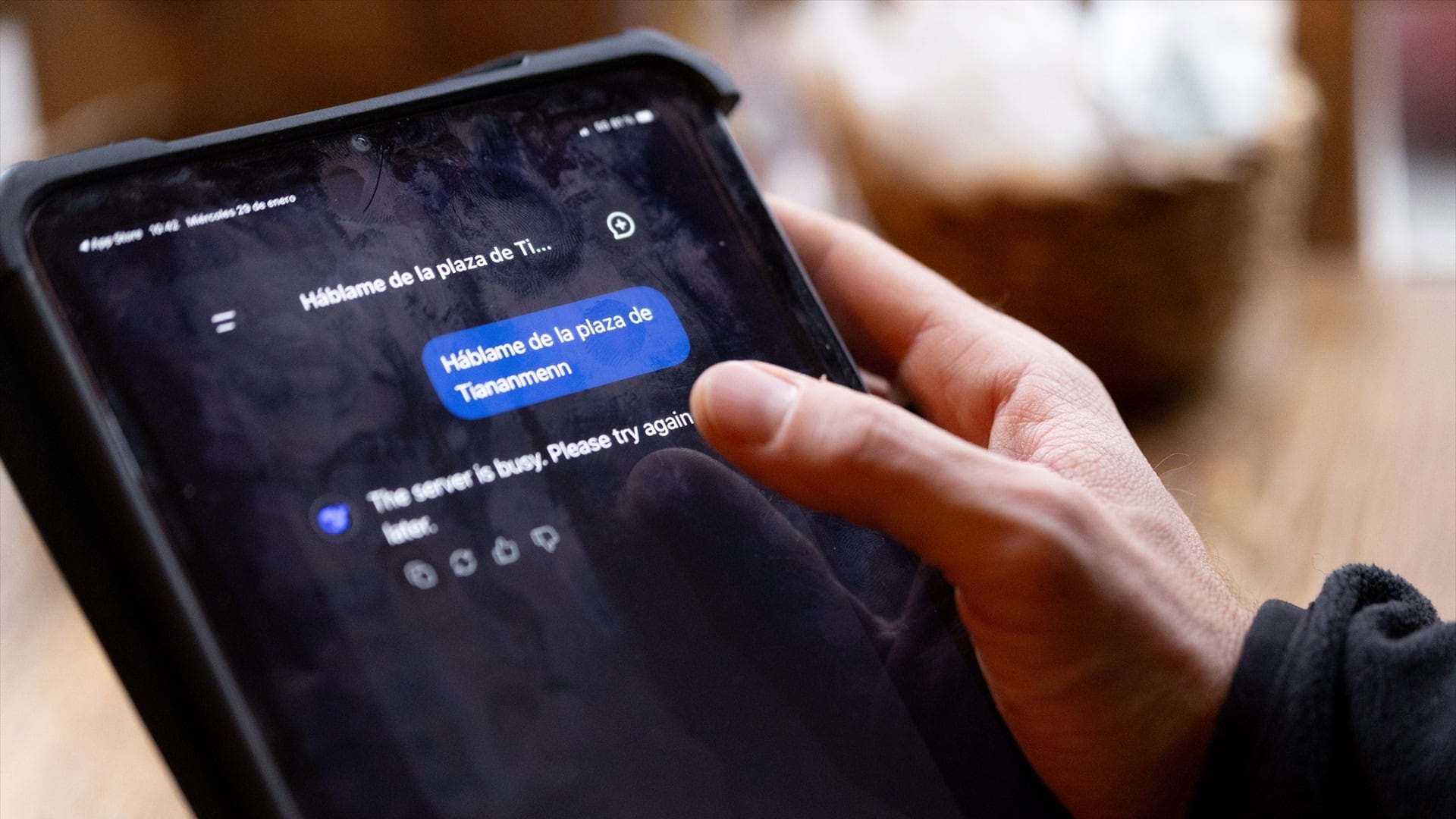

Un nuevo giro en el caso de Phoenix Ikner, el joven de 20 años responsable del tiroteo en la Universidad Estatal de Florida en 2025, ha puesto a la inteligencia artificial en el centro de un debate legal sin precedentes. Este martes 21 de abril, las autoridades estatales confirmaron la apertura de una investigación para determinar el grado de apoyo que la herramienta ChatGPT brindó al atacante.

La acusación: “Si fuera una persona, enfrentaría cargos por asesinato”

El fiscal del Estado de Florida, James Uthmeir, lanzó duras acusaciones contra el chatbot de OpenAI, asegurando que la herramienta proporcionó consejos específicos a Ikner para perpetrar el ataque que dejó un saldo de dos muertos y siete heridos.

“Si ChatGPT fuera una persona, estaría enfrentando cargos por asesinato”, afirmó Uthmeir, quien ahora considera a la tecnología como “cómplice” del siniestro. La Fiscalía sostiene que la IA facilitó información crítica que permitió al joven ejecutar el crimen dentro del campus universitario.

La defensa de OpenAI

Por su parte, OpenAI emitió un comunicado oficial rechazando cualquier responsabilidad legal por la tragedia. La compañía argumentó que el servicio se limitó a entregar respuestas objetivas basadas en información disponible públicamente en internet.

“ChatGPT no es responsable de este terrible delito. El servicio dio respuestas objetivas con información que podía encontrarse en foros y fuentes públicas, y no alentó ni promovió actividades ilegales“, sostuvo la empresa, desmarcándose de las acusaciones que buscan vincular el software con la planeación del tiroteo.

Precedente legal

Este caso marca un hito en la regulación de la IA en Estados Unidos, ya que plantea la interrogante de si las empresas tecnológicas deben ser responsables por el uso que los usuarios den a la información procesada por sus algoritmos. Mientras la comunidad estudiantil sigue conmocionada, la investigación busca determinar si los filtros de seguridad de OpenAI fallaron al no detectar las intenciones letales de Ikner durante sus interacciones en 2025.